„Vznik superinteligence bude významnější událost než kroky korporací a států,“ říká filozof Bostrom

Umělá inteligence pohání sociální sítě i naše telefony, za pár let prošla prudkým vývojem. Oxfordský filozof Nick Bostrom varuje, že se nám může stát osudnou. „Mohla by vzniknout AI, kterou vůbec nezajímají lidské hodnoty,” říká ředitel britského Institutu pro budoucnost lidstva. Jeho předpovědi zní jako z dystopického románu, vyplatí se mu ale naslouchat. Abychom se za pár let nedivili, jakou budoucnost nám stroje chytřejší než my připraví.

Vaše kniha Superinteligence vyšla v roce 2014. Rozebíráte v ní nebezpečí, která s sebou přináší prudký rozvoj umělé inteligence. Jak jste s úrovní současné kritické diskuze o AI spokojený?

Od vydání mé knihy se o něco zlepšila. Tehdy se o tom moc nemluvilo. Výzkum, který začal už před mnoha lety, postupoval dál, ale skoro nikdo nepřemýšlel nad tím, co se stane, až jednou dojdeme do cíle. Tím nikdy nebylo jen automatizovat konkrétní úkony, ale vytvořit stroj s univerzální inteligencí, podobnou té, která zaručuje lidem na planetě Zemi výsadní postavení. Tedy takzvanou superinteligenci. A tahle diskuze se během posledních tří, čtyř let dost proměňuje.

O budoucnosti umělé inteligence se mluví mnohem seriózněji a trochu se rozebírá i superinteligence. Vznikly výzkumné skupiny, které se snaží technicky vyřešit, jak by superinteligence vzala v úvahu dobro lidstva a jak její činnost kontrolovat. Takže diskuze je určitě lepší, než byla, ale přesto ji lidé neberou dost vážně. Neuvědomují si, že vznik umělé superinteligence bude dost možná ta nejdůležitější událost, co se v lidské historii kdy stane. Přesto se výzkumu superinteligence věnuje stále nepoměrně méně pozornosti a peněz.

Nick Bostrom (* 1973) je švédský filozof, který působí na Univerzitě v Oxfordu. Je zakladatelem Future of Humanity Institute (Institut pro budoucnost lidstva). Věnuje se globálním hrozbám, transhumanismu nebo rizikům, které přináší rozvoj umělé inteligence. Je autorem knihy Superinteligence, která vyšla v roce 2014 a jako inspiraci ji citují Bill Gates nebo Elon Musk. Časopis Foreign Policy zařadil Bostroma v roce 2009 a 2015 do seznamu stovky nejdůležitějších globálních myslitelů.

Jaký je tedy nejpravděpodobnější apokalyptický scénář? Jak nás superinteligence zničí?

V principu jde o to, že by mohla vzniknout umělá inteligence, kterou vůbec nezajímají lidské hodnoty nebo lidský blahobyt a má nějaký jiný cil. Klasický příklad a myšlenkový experiment je AI naprogramovaná k tomu, aby vyrobila co nejvíc kancelářských svorek, například nějaká v továrně na kancelářské potřeby. Prostě inteligence s účelem, který nemá žádný vztah k lidským hodnotám. Pokud by taková AI byla superinteligentní, mohla by mít moc měnit a optimalizovat budoucnost tak, aby svůj účel co nejlépe naplnila. A když se zamyslíte, jak by svět optimalizovaný pro výrobu kancelářských svorek vypadal, byl by to svět bez lidí a lidských hodnot. Dost možná by to byla Země celá přetvořená v továrnu na kancelářské svorky, ze které by vylétaly sondy s cílem přetvořit takto i další planety. A jako jakýsi vedlejší efekt by taková AI vyhodnotila, že je lepší se lidí zbavit. Nebo by nám zakázala ji vypnout, případně v rámci maximalizačního programu vyčerpala přírodní zdroje.

Podle vás je řešením stroje a umělou inteligenci lidské hodnoty naučit – mluvíte o tom třeba ve své přednášce na konferenci TED. Ale jsou lidské hodnoty opravdu univerzální? Vždyť se na nich ani neshodneme.

Ano, ve skutečnosti jsou to dva problémy. Jedním je otázka, jak „lidskost“ v určitém čase umělou inteligenci naučit. To je velká technická hádanka. A pokud by se nám ji povedlo vyřešit, budeme mít ještě politický problém. Jaké hodnoty do AI vtělíme a kdo by o tom měl rozhodovat? Jaké instituce a jakým mechanismem? A až superinteligence vznikne, bude na přemýšlení pozdě. Pokud někdo vyřeší první problém, na ten druhý budeme mít už jen jeden pokus.

Je řešením zavádění systémů umělé inteligence omezovat?

Když se podíváme na to, k čemu se dnes umělá inteligence požívá, jsou to z drtivé většiny velmi pozitivní věci. Až vytvoříme superinteligenci, bude mít obrovský potenciál – bude užitečná ve všech sektorech ekonomiky, medicínském výzkumu, ekologii, vesmírném průmyslu a vlastně kdekoliv, kde je užitečná i lidská inteligence. Takže prakticky všude. Ale tahle hypotetická budoucnost má, jak už jsem naznačil, taky existenční rizika. Nicméně, já si myslím, že ji jednou prostě postavíme. Jediné, co by nám to mohlo překazit, je, že se dřív sami zničíme – třeba nějakou biologickou zbraní hromadného ničení. To je bohužel taky možné.

Ale pokud bude věda pokračovat dosavadním tempem, myslím, že nakonec budeme schopni přenést inteligenci do stroje. Ten moment vnímám jako jakousi bránu do jiného světa zářné budoucnosti, kterou lidem superinteligence může přinést. Ale musíme si dát pozor, abychom se po cestě kvůli příliš vysoké rychlosti nevybourali. Řešením není vývoj AI systémů zastavovat nebo zpomalovat, musíme si naopak připravit půdu pro optimální startovní podmínky, až jednou k vytvoření superinteligence dojde.

Země pokrytá továrnami na svorky je dost fantastická vize. Skoro za hranou představivosti. Exprezident Obama v rozhovoru pro magazín Wired zmínil konkrétně vaši práci jako inspirativní. Taky ale poznamenal, že je podle něj lepší řešit problémy, které působí dnešní umělá inteligence v současnosti. Jak rozdělit naši pozornost mezi krátkodobé a dlouhodobé problémy?

Nesouhlasím s tím, že v tom, kolik pozornosti věnujeme dlouhodobým a krátkodobým dopadům AI, je nějaká nerovnováha. Dlouhodobější otázky jsou nakonec mnohem důležitější, a přesto se jim na plný úvazek věnuje po celém světě jen málo lidí. A ano, souhlasím, že příklad se svorkami je trochu fantastický, je to taková filozofická groteska, která má ale ilustrovat obecnější problém. Ukazuje, co může udělat nějaká náhodná funkce, utilitární program, podle kterého se superinteligence z čistě praktických důvodů rozhodne způsobem, který půjde proti lidských zájmům.

Často se zmiňuje ještě jeden možná jednodušší myšlenkový experiment. Představte si hedgeový fond pod správou umělé inteligence, která má za cíl maximalizovat zisk, případně přímo zasahuje do světa, manipuluje s trhy a píše otázky do online diskuzí, aby zjistila víc informací. Je velmi těžké odhadnout, jak by svět optimalizovaný pro maximální zisk tohoto fondu vypadal a jestli je to vůbec dobrý nápad. Proto potřebujeme nástroje pro kontrolu umělé inteligence, které půjdou škálovat, pomocí kterých se AI může učit lidské hodnoty, případně je rozeznávat třeba z lidského chování a dialogu. Budeme muset zajistit, aby případná superinteligence byla motivovaná naše hodnoty naplňovat. Velmi těžký intelektuální problém je to taky proto, že ho musíme mít vyřešený předtím, než superinteligence přijde. Potom už bude pozdě na to začít výzkum. Pro ilustraci musíme používat myšlenkové experimenty nebo matematické abstrakce. To je zatím to nejlepší, co máme.

Do výzkumu umělé inteligence dost investuje třeba Elon Musk. Co na jeho snahy říkáte?

Musk udělal několik věcí. Jednak dal řadu peněz do fondu pro výzkum bezpečnostních otázek okolo umělé inteligence a vypsal otevřené grantové řízení. Kromě toho ale taky spoluzaložil OpenAI, neziskovou výzkumnou skupinu, která se věnuje takzvanému kontrolnímu problému, tedy tomu, jak zajistit, aby superinteligence napomáhala lidským cílům. Je skvělé, že se někdo věnuje konkrétním projektům, protože jen volat po širší diskuzi nestačí.

Otevřené hlavy je podcastová série rozhovorů s předními intelektuály. Její druhou sérii Radio Wave vysílá každý čtvrtek od 15:00. Přihlaste se k odběru podcastu na wave.cz/podcasty.

Jak by měl výzkum superinteligence probíhat? Měl by zůstat na státní úrovni, nebo je ho potřeba řešit v mezinárodním měřítku?

Věřím, že vznik superinteligence bude událost významnější než kroky jakékoliv korporace nebo státu. Superinteligence se bude týkat celého lidstva. Musíme proto nastavit taková pravidla, aby sloužila pro dobro všech lidí. V současné situaci je ale nejefektivnější, když se bude výzkum dál dělat v malých skupinách. Základní výzkum nedává smysl dělat třeba na úrovni OSN, lepší je prostě sebrat pár talentovaných lidí, někoho, kdo je zaplatí, a začít pracovat.

Zdá se, že většina systémů umělé inteligence vzniká „za zavřenými dveřmi“, ve firmách, které nejde dost dobře kontrolovat. Neznepokojuje vás to?

Nesouhlasím. Výzkum umělé inteligence je ve skutečnosti velmi otevřený vědní obor. Jen se přesunul z akademického do korporátního světa. Ještě před pěti lety probíhal základní výzkum hlavně na univerzitách, dnes se mu věnují lidé ve velkých firmách – Googlu, Facebooku, Baidu, Microsoftu. Mnoho z těch nejlepších vědců z oboru pro ně pracuje. Jejich poznatky jsou ale vždycky velmi brzy veřejně dostupné. Výzkumníci se předhání v tom, kdo své myšlenky publikuje první, kdo s nimi první vystoupí na konferenci, a firmy samotné vytváří nástroje, které práci s neuronovými sítěmi zjednodušují. Vytvářejí frameworky, programovací jazyky a prostředí, jako je třeba otevřený systém TensorFlow, díky kterému lze s umělou inteligencí jednoduše začít. Až donedávna byl jediná výjimka Apple, který rád dělá velká odhalení nových produktů. Ale i ten musel svoji politiku změnit, protože nemohl sehnat ty nejlepší lidi přes strojové učení. Ti totiž chtějí pracovat v místech, kde je jim dovoleno publikovat.

Jakou roli hraje v diskuzi o umělé inteligenci kultura? Přijde vám přínosné třeba kritické umění nebo sci-fi?

Obecně řečeno, ano. Vzhledem k obrovskému dopadu umělé inteligence to není jen technická otázka, ale věc, se kterou se bude muset vypořádat celá lidská kultura. Takže potřebujeme všechny prostředky, které jako lidstvo máme, včetně umění, literatury a politické teorie, abychom se s ní vyrovnali. Jen počítačová věda nestačí. Zároveň si ale myslím, že velkou překážkou v pochopení systémů umělé inteligence je, že máme tendenci je polidšťovat. Představujeme si je jako velké nerdy, jako lidi bez sociálních schopností, kterým prostě jde dobře analyzovat a zpracovávat dat. A to nám v přemýšlení nad tím, jak by superinteligence mohla vypadat, ve skutečnosti brání.

V roce 2013 jste se podílel na anketě, ve které experti odpovídali, kdy superinteligence přijde. Mediánová odpověď byl rok 2050, s padesátiprocentní jistotou. Co si myslíte dnes vy?

Já se radši přesných předpovědí zdržuji. Musím ale říct, že moje časová osa se od té doby, co moje kniha vyšla, zúžila. Vývoj ve strojovém učení byl rychlejší, než jsme tehdy čekali. Úspěchy systémů DeepMind, AlphaGo, teoretický pokrok v generativních sítích, které neumí jen klasifikovat obrázky, ale taky obrázky nebo řeč generovat, jsou ohromující. V laboratořích je také spousta nových slibných projektů, které ještě nenašly komerční využití a nejde je dost dobře ukazovat veřejnosti. Zároveň je vidět, že výzkum umělé inteligence přitahuje mnoho talentovaných lidí. Před pěti, deseti lety se ti nejlepší matematici věnovali čisté matematice nebo třeba teoretické fyzice, dnes jdou místo toho studovat umělou inteligenci. Dá se předpokládat, že rychlý rozvoj bude pokračovat.

Alespoň z venku to ale vypadá, že systémy umělé inteligence jsou stále trochu hloupé, například nedokážou odlišit tygra od pohovky s tygrovaným vzorem. Jak se odsud dostaneme do situace, kdy způsobí planetární apokalypsu?

Víte, dokud to nebude superinteligence, tak vždycky bude mít nějaké nedostatky. Rozlišit tygry a pohovky navíc se současnými technologiemi jde. Ale přesto mají dnešní systémy spoustu problémů. Potřebujeme lepší algoritmy pro samostatné učení, vymyslet, jak neuronové sítě naučit uvažovat konceptuálně a vztahově. Zatím tyto věci neumíme dělat moc efektivně. Moje nejistota ohledně časového rámce pramení i z toho, že tyhle věci bude nejdřív potřeba vyřešit, a k tomu budou muset přijít velké teoretické pokroky. Možná se podaří postavit obrovské neuronové sítě, které půjde spojit dohromady a dojít velkých zlepšení. Možná se ale kola výzkumu zadřou a schopnosti současných systémů zůstanou na úrovni detekce objektů, napodobování lidských smyslů a bude třeba vymyslet nějaké úplně nové, průlomové algoritmy. Obě možnosti jsou pravděpodobné. Takže podle mě nedává smysl říkat „je to nevyhnutelné“, ale spíš mít několik různě pravděpodobných odhadů, kdy superinteligence přijde, abychom se na její příchod mohli správně připravit.

AI je jedna věc, ale váš Future of Humanity Institute se věnuje i dalším existenčním rizikům. Jaké je podle vás druhé nejhorší nebezpečí, které nám hrozí?

Pokud se na to díváme v horizontu třeba příštího století, tak největším nebezpečím budou sami sobě lidé. V přírodě jsme přežili po stovky tisíc let, nezničily nás ani asteroidy nebo zemětřesení a vulkány. Jenže jako lidé vnášíme do přírody úplně nové věci, se kterými nemáme žádnou předchozí zkušenost. Většina z nich bude důsledkem velkých technologickým změn. Ale kdybych si měl vybrat jednu, byla by to biotechnologie, syntetická biologie, kde probíhá zuřivý vývoj. A umím si představit, že pomocí biotechnologických technik půjde vytvořit hodně zlé věcí, třeba snadno dostupné zbraně hromadného ničení. Ale je potřeba vzít v úvahu ještě to, co nejspíš ani nevíme. Kdybyste se zeptal na stejnou věc před sto lety, nikdo by syntetickou biologii nezmínil a nenapadly by ho ani nanotechnologie nebo jaderné zbraně. A přitom dnes jsou to ty nejviditelnější nebezpečí. Myslím, že během příštích let uvidíme věci, které si dnes představit vůbec neumíme.

Nick Bostrom svůj talent pro filozofii objevil, když v oblastní knihovně jako šestnáctiletý kluk narazil na Nietzscheho a Schopenhauera. Má tři bakalářské tituly včetně diplomu z logiky, a tak nepřekvapí, že mluví se skoro matematickou přesností. Pusťte si audio verzi rozhovoru s předním světovým futurologem.

Nejposlouchanější

Více z pořadu

Mohlo by vás zajímat

E-shop Českého rozhlasu

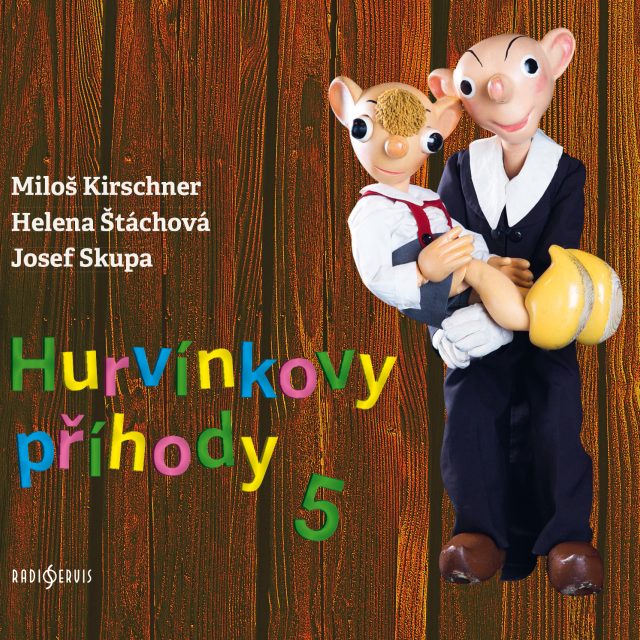

Hurvínek? A s poslední rozhlasovou nahrávkou Josefa Skupy? Teda taťuldo, to zírám...

Jan Kovařík, moderátor Českého rozhlasu Dvojka

Hurvínkovy příhody 5

„Raději malé uměníčko dobře, nežli velké špatně.“ Josef Skupa, zakladatel Divadla Spejbla a Hurvínka