Vidět už neznamená vědět. Deepfakes útočí na ženy

Nikdy nikomu neposílej své nahé fotky, nikdy s nikým netoč domácí porno. Nikdy nevíš, co by s tím ten druhý mohl udělat. To je jedna z pouček, které se dnes učí děti během preventivních programů o kyberšikaně a slyšeli jsme ji snad všichni. Jenže k čemu nám to je, když je možné za pomoci umělé inteligence zkonstruovat realistické deepfake video, na němž může být kdokoliv z nás účastníkem bukkake party, aniž bychom kdy něco takového provozovali?

Technologie deepfakes, tedy falešných videí, kdy je hlas i obličej namontován do videa, v němž se dotyčný původně vůbec nevyskytoval, se vyvíjí neuvěřitelnou rychlostí. Před pár lety bylo zhotovení falešného a uvěřitelného videa náročnou disciplínou vyžadující profesionální zázemí a odborníky. Dnes to chytrý software zvládne za pár hodin a vývoj pokračuje. Například ještě v roce 2018 deepfake videa neuměla simulovat realistické mrkání a odhadovalo se, že to vývojáři zvládnou vyřešit zhruba za rok. Zabralo jim to ale pouhé dva měsíce.

O deepfakes se mluví především jako o nástroji propagandy a politického boje. Přestože zneužití této technologie v politice je obrovskou hrozbou pro demokracii, nejčastější obětí deepfakes jsou prozatím ženy. Společnost Deeptrace Lab, která vyvinula software na odhalování deepfake videí, tvrdí, že 96 % upravených záznamů zobrazuje právě ženy a v drtivé většině případů v pornu. Většinou se jedná o celebrity, ale rozšiřuje se i produkce deepfake porno videí aktivistek či novinářek a často je používají zhrzení muži jako nástroj pomsty bývalým přítelkyním. Problém zesiluje i zlevňování technologie. Jedna z redaktorek amerického časopisu Vice si nechala vytvořit vlastní deepfake porno video za pouhých 30 dolarů. Stačilo k tomu zhotoviteli zaslat dostatek vlastních fotografií či videí, z nichž pak umělá inteligence vyčetla data o tom, jak by se ve videu domontovaný obličej měl chovat. V době, kdy neustále dokumentujeme svůj život na Facebooku a Instagramu, není pro nikoho obtížné dostatek materiálu jednoduše stáhnout a například firma Samsung podle svých prohlášení vyvíjí aplikaci, která umožní vytvořit deepfake video na základě jediné fotografie.

Falešná porno videa mohou zničit kariéru a vztahy, ale způsobují i závažná psychická traumata. Společnosti jako Google, Facebook, Pornhub i Reddit se sice snaží tento typ obsahu blokovat, ale jeho autoři se snadno přesouvají na jiné platformy, například na téměř necenzurované fórum 8chan, které mimo jiné proslulo jako shromaždiště všemožných rasistů a mizogynů.

Čtěte také

Základní poučky bezpečnosti na internetu přestávají fungovat. Kdokoliv o nás může poměrně snadno vytvořit cokoliv, co vypadá jako pravda, ale je to záměrná, ubližující lež. Zastánci deepfakes hovoří o svobodě projevu. Ve skutečnosti je ale opět omezována především svoboda žen, na které útoky primárně cílí. A to ať už jejich svoboda zveřejňovat své potenciálně zneužitelné fotky na sociálních sítích, nebo svoboda se vůbec ve veřejném prostoru vyjadřovat. Už teď jsou častěji oběťmi nenávistných komentářů, hrozeb a urážek. Nyní přibývá možnost, že za jejich názory někdo do světa vypustí falešné porno s jejich obličejem.

V jednom ale mají zastánci rozvoje deepfake programů pravdu. Technologie tu jsou a dál se vyvíjí. Budeme se muset naučit s nimi fungovat. Pro začátek by mohlo stačit zkusit přestat zostouzet ženy za účinkování v pornu. Přestane-li být nahota a zobrazování při sexu něčím ponižujícím, stane se deepfake jako nástroj pomsty neúčinným. Stejně je to nebetyčné pokrytectví, když se většina lidí na porno dívá.

Proč se z digitálně upraveného videa stala zbraň proti ženám a jak se deepfakes bránit? Poslechněte si komentář Johanny Nejedlové.

Nejposlouchanější

Více z pořadu

Mohlo by vás zajímat

E-shop Českého rozhlasu

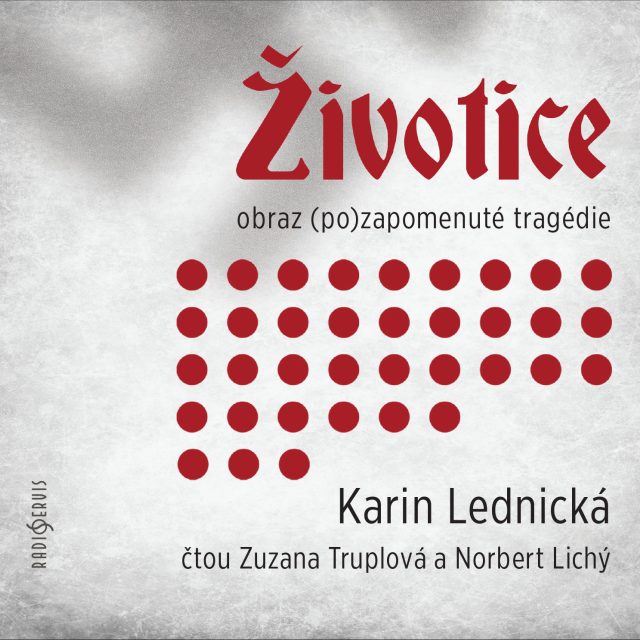

Závěr příběhu staré Karviné, který měl zůstat pod zemí

Karin Lednická, spisovatelka

Šikmý kostel 3

Románová kronika ztraceného města - léta 1945–1961. Karin Lednická předkládá do značné míry převratný, dosavadní paradigma měnící obraz hornického regionu, jehož zahlazenou historii stále překrývá tlustá vrstva mýtů a zakořeněných stereotypů o „černé zemi a rudém kraji“.