Žít Minority Report. Může umělá inteligence předpovídat zločin bez předsudků?

Žhavým trendem v boji s kriminalitou je využití umělé inteligence. Neuronové sítě propojené s policejními systémy dokážou předpovědět, kdo bude příště střílet a v jaké části města posílit hlídky. Jestli doopravdy fungují, ale není jisté. Zato můžou utvrzovat etnické stereotypy nebo narušovat soukromí.

Pamatujete na sci-fi Minority Report? Policie v něm dokázala předpovědět vraždu a zabránit jí v momentě, kdy se k ní pachatel teprve chystal. Speciální jednotka Toma Cruise chodila do akce na základě věšteb tří telepatů, místo těch mají dnes američtí policisté předpovědi umělých neuronových sítí, které se samy učí. Fungují v Chicagu, New Orleans nebo Los Angeles, dokáží najít spojení mezi registracemi aut a zbraní, adresami, údaji z policejních databází nebo sociálními médii a vytipovat rizikové osoby a oblasti. Chicagská policie si například nechala sestavit seznam lidí, u kterých se dá kriminální činnost očekávat, a varovala je, co se stane v případě, že nějaký zločin znovu spáchají.

Ani křemíkoví policisté nejsou neutrální

Data ale pochází z největší části od policistů samotných. Jak upozorňuje kolektiv Human Rights Data Analysis Group, údaje o zločinech zaznamenaných policií vůbec nemusí odpovídat reálné situaci – některá místa mají vyšší výskyt zločinů prostě proto, že do nich policisté víc chodí. A protože se model na základě nově získaných dat neustále zlepšuje, může vzniknout sebepotvrzující se smyčka. Tahle slepá skvrna algoritmického předpovídání kriminality může utvrzovat etnické nebo sociální stereotypy a bariéry. Těžko čekat, že budou mít policisté přesná data o bohatých čtvrtích, pokud do nich chodí míň. V nejhorším mohou takové systémy podněcovat policii k přehnanému kontrolování vyloučených lokalit, případně k preventivním zásahům proti lidem, kteří jsou nevinní, ale mají nevhodný osobnostní profil. Velmocí ve strojovém předpovídání kriminality jsou Spojené státy, které současně bojují s rasově zabarvenou policejní brutalitou, podle webu Mapping Police Brutality jako Afroameričan máte v USA třikrát větší šanci být zastřelený policistou než běloch.

Nejvýznamnějším hráčem na trhu s prediktivními systémy je americká firma Palantir Technologies ze Silicon Valley. Jak dokládá rozsáhlá investigativní reportáž webu The Verge, na řadě míst Palantir svoje projekty uváděl v chod bez vědomí představitelů městských samospráv. Hlad neuronových sítí po datech může vést i k tomu, že policie začne nadbytečně kontrolovat i lidi, kteří na žádném seznamu rizikových osob neskončili. V New Orleans se po startu programu od Palantiru policisté začali víc vyptávat i při rutinních výsleších. Policie firmám provozujícím prediktivní systémy navíc poskytuje přístup i do databází s citlivými údaji. Takové jednání by mělo projít demokratickým procesem a podléhat kontrole. A nejprve by se o něm měla vést širší veřejná debata.

Umělá inteligence odhalí i disidenty

„Věštecký“ software zjednodušuje policejní práci, má však svoje úskalí

„Pane Marksi, z pověření okresu Kolumbie, oddělení PreCrimu, vás zatýkám za budoucí vraždu Sarah Marksové a Donalda Doobina, která měla být spáchána dnes, 22. dubna v 8 hodin 4 minuty,“ říká John Anderton, postava hraná Tomem Cruisem ve snímku Minority Report, nedokonalé adaptaci stejnojmenné povídky od Philipa K. Dicka. V posledních letech začínají prediktivní metody používat některé americké policejní sbory. Ve skutečnosti však používají takzvaná velká data a software namísto zázračných potomků uživatelů drog, jak tomu bylo v Minority Report.

Prediktivní neuronové sítě neslouží jen policistům. S předpovídáním kriminality koketuje i Čína, podle magazínu Independent chce předpovídat nejen terorismus, ale i sociální nepokoje. A vzhledem k liknavému přístupu Čínské lidové republiky k lidským právům a ochraně lidského soukromí je téměř jisté, že takový systém rozhodně nebude použitý jen proti vnějším hrozbám. Dánsko v roce 2016 za desítky milionů dolarů nakoupilo systém k identifikaci potenciálních teroristů, ale kvůli pravidlům EU pro nakládání s osobními daty si musela země pro jeho používání schválit výjimku.

Spousta programů pro předpovídání zločinu je v provozu několik let (třeba v Chicagu už funguje od roku 2013) a širší společenská diskuze o jejich dopadech chybí. Studie, ve kterých odborníci zkoumali, jestli umělá inteligence skutečně snižuje kriminalitu, k jasnému závěru nedošly. Důvěru nevzbuzuje ani masivní lobbing, pomocí kterého technologické firmy protlačují svoje systémy mimo běžné demokratické cesty. Českou republiku to teprve čeká – a bude dobré být ve střehu, abychom prediktivním sítím neuvěřili příliš. Tom Cruise v Minority Report na falešnou věštbu taky doplatil. Očistit svoje jméno mu dalo zabrat.

Jak umělou inteligenci použít tak, aby nepodporovala policejní násilí? Poslechněte si audioverzi příspěvku.

Pokud vás téma předpovídání zločinu zajímá, festival Jeden svět ve středu 7. března uvede dokument PreKrim Matthiase Heedera.

Nejposlouchanější

Více z pořadu

Mohlo by vás zajímat

E-shop Českého rozhlasu

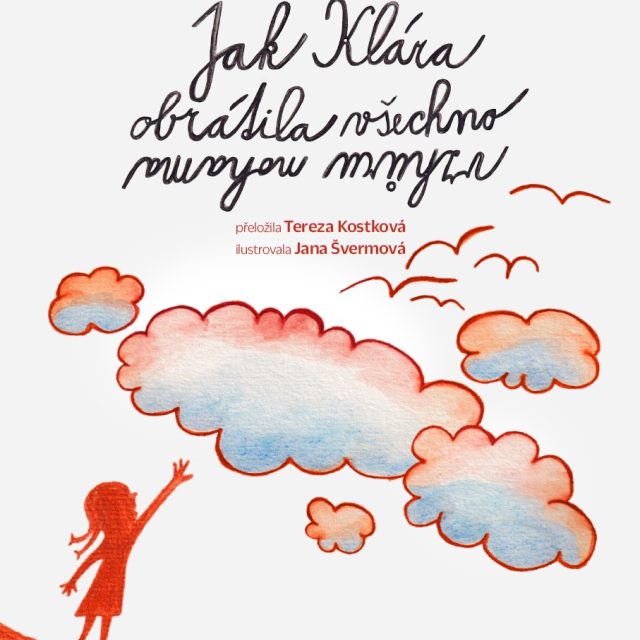

Kdo jste vy? Klára, nebo učitel?

Tereza Kostková, moderátorka ČRo Dvojka

Jak Klára obrátila všechno vzhůru nohama

Knížka režiséra a herce Jakuba Nvoty v překladu Terezy Kostkové předkládá malým i velkým čtenářům dialogy malé Kláry a učitele o světě, který se dá vnímat docela jinak, než jak se píše v učebnicích.